Ach und da gibt es ja noch ein weiteres, passendes, wichtiges Video zu WatchOS 8.3:

Beiträge von klausN80X

-

-

Nein, du hast seinen Post aus dem Kontext gerissen.

Falsch!

Aufgrund weltweiter Proteste von Sicherheitsexperten (!) hatte Apple das Vorhaben verschoben und außerdem die iOS-Version 14.8.1 herausgebracht.

So konnten sie ein notwendiges iOS-Update mit Fehlerbehebungen oder Sicherheitslücken anbieten, hielten sich aber alles offen.

Otto-Normalverbraucher vergisst schnell bzw. hat kein tieferes Interesse an diesen Dingen oder glaubt einfach alles, weil bequemer.

Und genau das ist so richtig, was it-hase da schreibt, siehe Bericht von ifun.de.

Ok, zugegeben, das Wort "Falsch" ist vielleicht etwas hart gewählt.

-

Paul Kalkbrenner Sky and Sand und das darauf folgende Stück in der Orchester-Version. Einfach genial!

-

Hier ein soeben erschienener Artikel von ifun.de zu dem Thema:

"

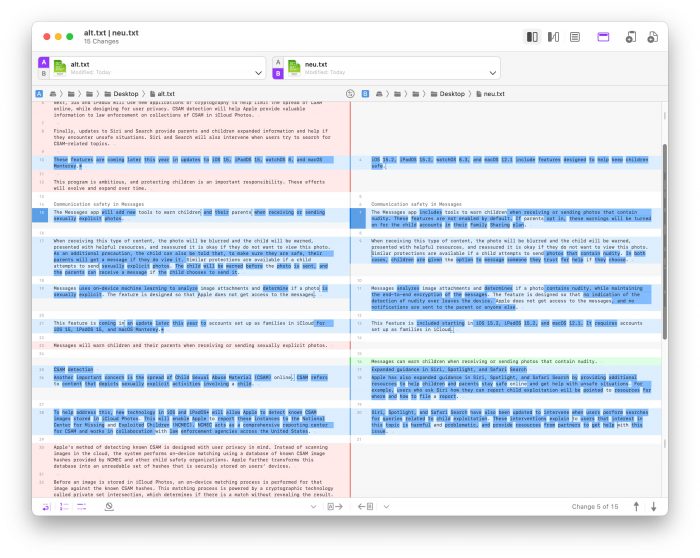

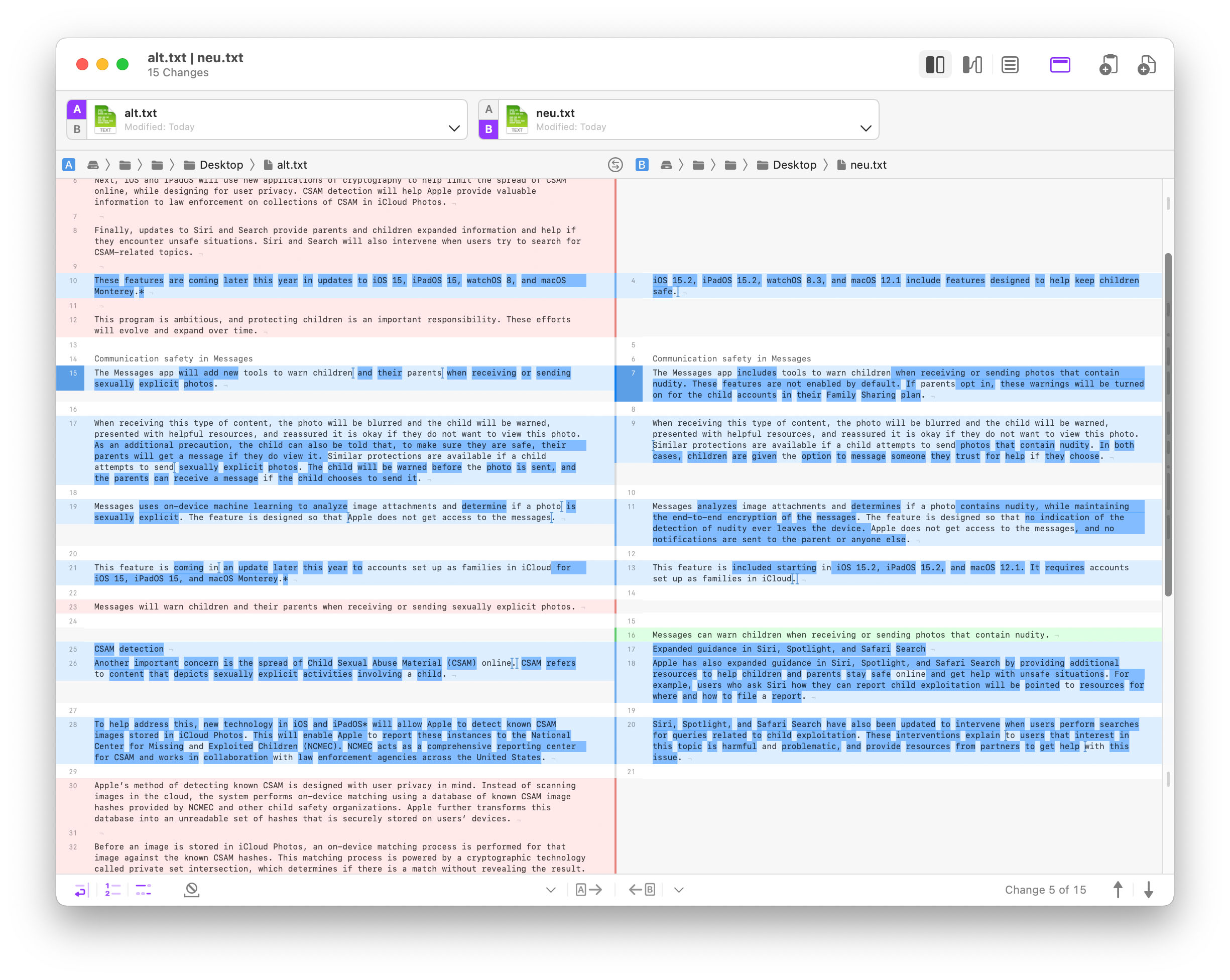

Im Anschluss an die Ausgabe der jüngsten iOS-Aktualisierung auf Version 15.2 hat Apple die Sonderseite „Erweiterter Schutz für Kinder“ grundlegend überarbeitet und hier jegliche Verweise auf die baldige Einführung einer Missbrauchs-Erkennung entfernt.

Während Apple hier bislang noch über die hauseigenen Pläne informierte, zukünftig alle zum Upload in die iCloud vorgemerkten Fotos auf das Vorhandensein möglicher Missbrauchsmotive hin zu prüfen, taucht der Hinweis auf die geplante Suche nach „Child Sexual Abuse Material“, sogenannten CSAM-Bildern, nun überhaupt nicht mehr auf der Sonderseite auf.

Alle CSAM-Hinweise (und PDFs) entfernt

Dabei hat Apple nicht nur den Volltext ordentlich zusammengestrichen, sondern auch die Links auf die zahlreichen PDF-Veröffentlichungen entfernt, die auf der Übersichtsseite bislang zum Download angeboten wurden und technische Hintergründe zu Apples Vorgehensweise bei der Suche nach CSAM-Bildern skizzierten.

Seit Apples Ankündigung, an der Einführung eines lokalen Bild-Scanners zu arbeiten, sah sich das Projekt massiver Kritik ausgesetzt. Vor allem die Tatsache, dass Apple den Scan auf die Geräte seiner Anwender auslagerte und hier verdachtsunabhängig alle Bilder vor dem Upload von intelligenten Algorithmen prüfen wollte, stieß auf Kritik.

Apple hat den bisherigen Text stark zusammengestrichen

Sorge vor Missbrauch der Missbrauchserkennung

Apple, so der Vorwurf von Journalisten, Bundestagsabgeordneten, Bürgerrechtlern und Anwälten, würde damit eine Infrastruktur schaffen, die schnell für Begehrlichkeiten in autoritären Regimen sorgen würde. Apple könnte nicht garantieren, das die so etablierten technischen Voraussetzungen langfristig nicht auch zur Suche nach regierungskritischem Material eingesetzt werden würden.

Nun sind alle Hinweise auf den CSAM-Scan verschwunden. Auf der überarbeiteten Seite verweist Apple nur noch auf die mit iOS 15.2 eingeführte Nacktbilderkennung in der Nachrichten-App und die Interventionen von Siri und der Safari-Suche, wenn Anwender versuchen nach Missbrauchsbilder zu suchen.

Apple selbst hat sich zum Hintergrund der Überarbeitung noch nicht offiziell geäußert und lässt damit im unklaren, ob und wann es mit der implementierung eines CSAM-Scanners in iPhone und iPad weitergehen wird.

Alle Artikel, die wir bislang zum Thema verfasst haben könnt ihr in unserem Nachrichten-Archiv unter dem Schlagwort CSAM nachlesen. Hier eine Auswahl:

- Gegen die Bilderkennung in iMessage: Über 90 Lobby-Gruppen appellieren

- Mindestens 30 Fotos: Apple präzisiert Missbrauchs-Erkennung

- Apples geplante Fotoscans sorgen auch intern für massive Kritik

- Kinderporno-Scan: Apples Antworten lassen viele Fragen offen

- Apple-Kritik aus dem Bundestag: Lokaler Foto-Abgleich ein „Dammbruch“

- Offener Brief: „Apple-Überwachung verstößt gegen Pressefreiheit“

-

Apple hat nun alle Informationen über die geplant, kommende Funktion aus dem Netz genommen.

Erinnert mich irgendwie an das Verhalten von Whatsapp und ihren neuen AGBs.

Whatsapp: "Wir müssen das jetzt umsetzen. Oh ein Shitstorm. Na dann tütütü. Haben wir was von AGBs gesagt? Wir können uns gar nicht daran erinnern."

-

Gibt es nicht bereits schon seit viel früher Bedenken, was iOS und Apple angeht?

Apple könnte den Standort live mitverfolgen. iOS könne einen bevormunden. ...

-

Kurze Zwischenfrage: Wie werden denn diese Hashwerte geprüft bzw. wie entstehen diese überhaupt?

-

Aber um die Frage zu beantworten: Nein.

Windows RT hatte andere Strukturen.

Wobei Windows 11 allerdings nun auf weit mehr Hardware laufen soll als alle anderen MS-Systeme zuvor.

Von daher, geht probieren über studieren.

Denn es läuft nun auch auf meinem ehemaligen Windows 7 Notebook, das laut MS überhaupt nicht mit Windows 11 kompatibel sein soll.

Ja ne is klar Microsoft.

-

Guten Morgen, schönes Vorweihnachtliches "Überraschungs-Update", was uns da Apple unter den Weihnachtsbaum zaubert.

Hier das dazu passende Video von Apfelwelt:

-